第二节的学习内容为NLP大模型的LoRA微调。简单来说就是降低了训练参数,使模型在仅训练少量参数的情况下适配微调数据集,具体的原理想要详细了解的话还是推荐看一下原论文。

#学习过程

打开云上平台后,将左边栏的窗口向右边拉大,就可以看到笔记的完整名称了:

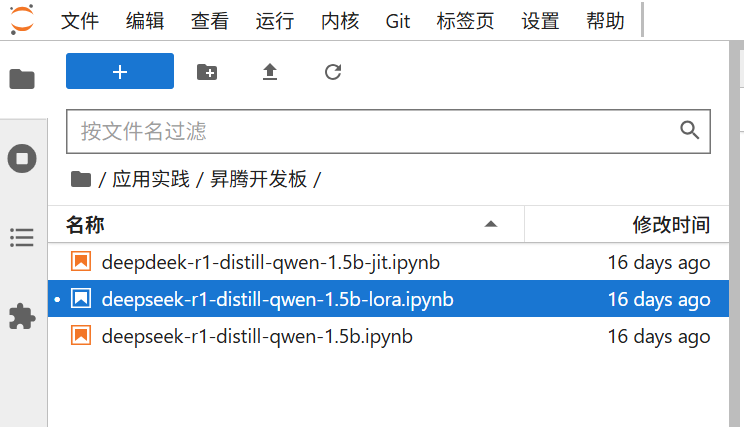

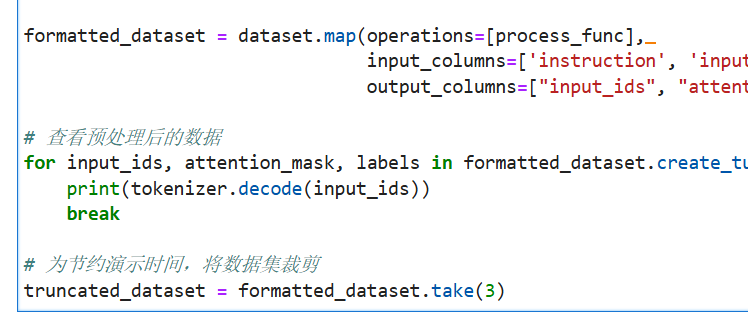

这一节我们选择deepseek-r1-distill-qwn-1.5b-lora.ipynb这个笔记打开,里面就是对模型进行LoRA微调的代码。前面的环境配置、数据集下载这些没什么好说的,直接运行就好,只需要注意一点就是示例代码里面为了节约时间是对数据集进行了裁剪的:

等到正式训练的时候一般会训练整个数据集。

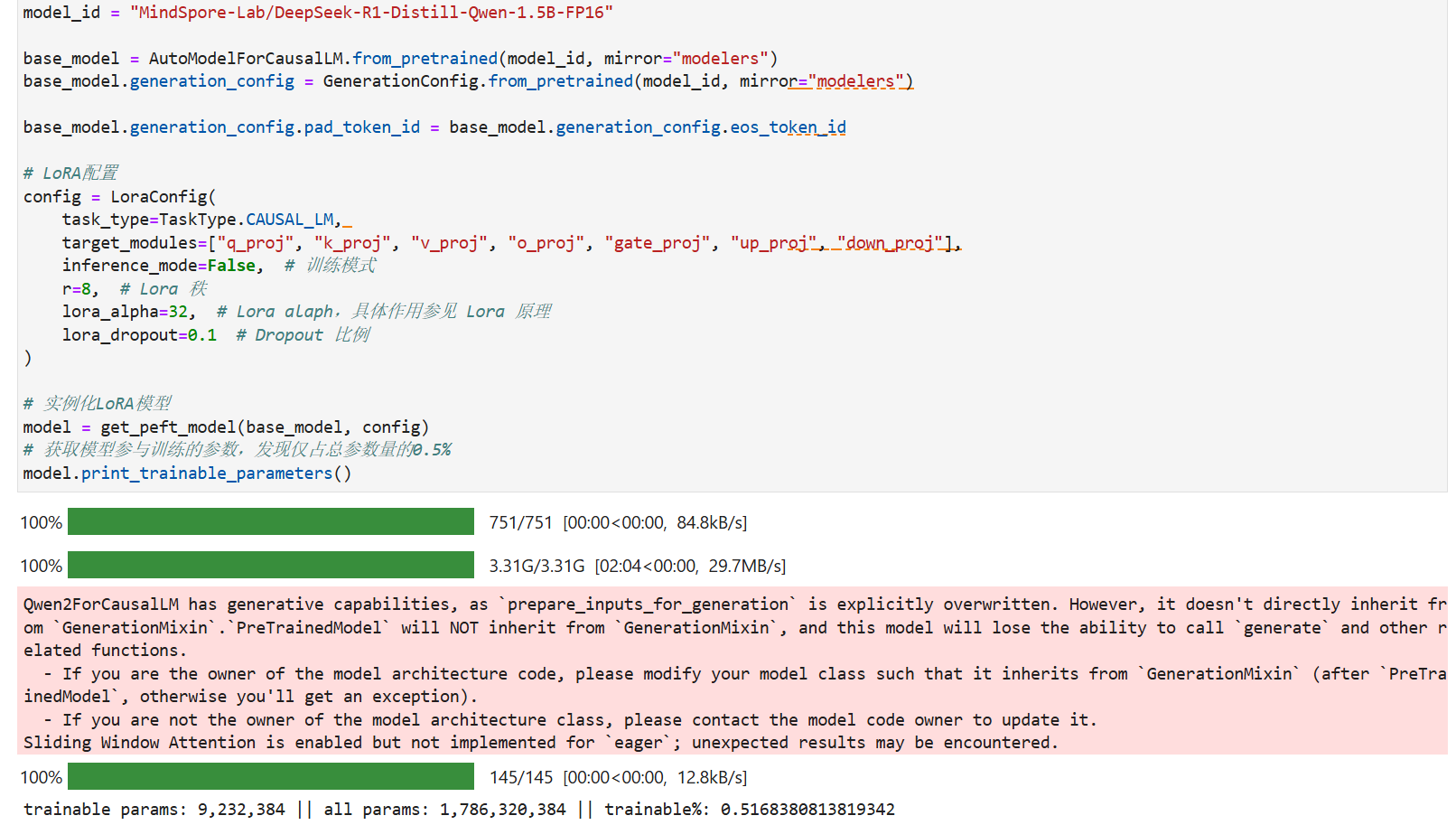

接下来可以配置lora参数,并实例化lora模型,在正式训练的时候可以调节其中的参数观察微调效果:

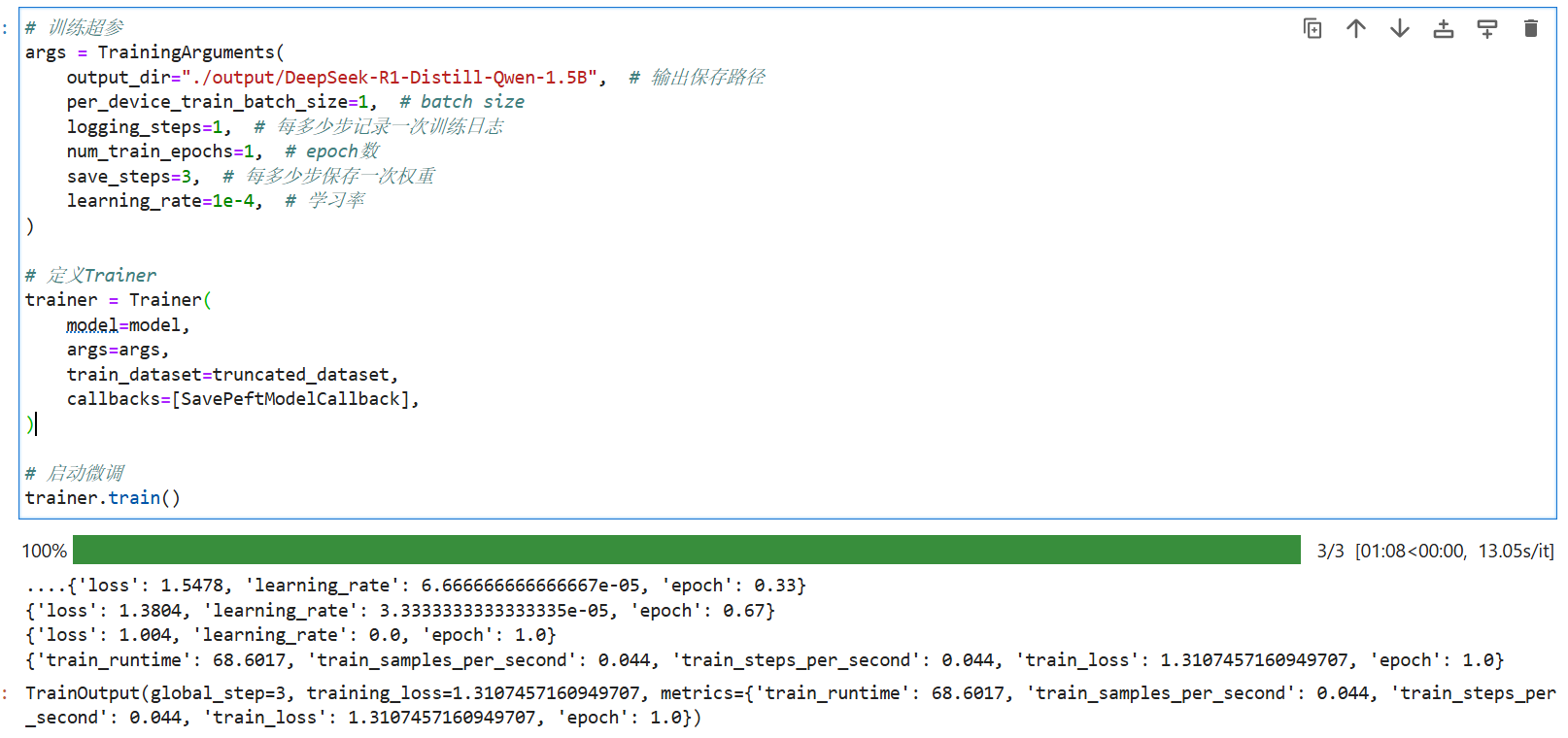

配置好lora参数之后就可以正式开始微调了,这里同样有各种配置参数,设置好参数运行即可:

#个人感受

总的来说昇思平台的训练过程与其他框架差异性不大,接口的调用也都很类似,差别可能主要在社区规模上还需要提升,也期待国产品牌能够一起把社区规模做起来。