本次学习

一:LoRA微调,其核心旨在用更少的资源让模型学东西,其中核心逻辑是先把别人训好的厉害模型(比如这里的 DeepSeek - R1 - Distill - Qwen)拿过来,当成 “地基”。在此基础上修改。通过在大模型上加装轻量插件节省资源提高算力。

其中 学习力度(lora_alpha参数),他是一个超参数,它在 LoRA 训练和推理过程中起到缩放的作用,影响模型学习的 “力度”。在训练过程中,lora_alpha与r一起参与计算缩放因子(scale factor),公式为scalefactor=lora_alpha/r,其中lora_alpha=32,r=8.。因此缩放就为4。较大的lora_alpha值,在同样的r下,会使缩放因子更大,也就意味着在训练过程中,LoRA 添加的参数更新幅度相对更大,模型会更 “激进” 地学习新的知识;反之,较小的lora_alpha

会让参数更新幅度更小,模型学习得更 “保守” 。

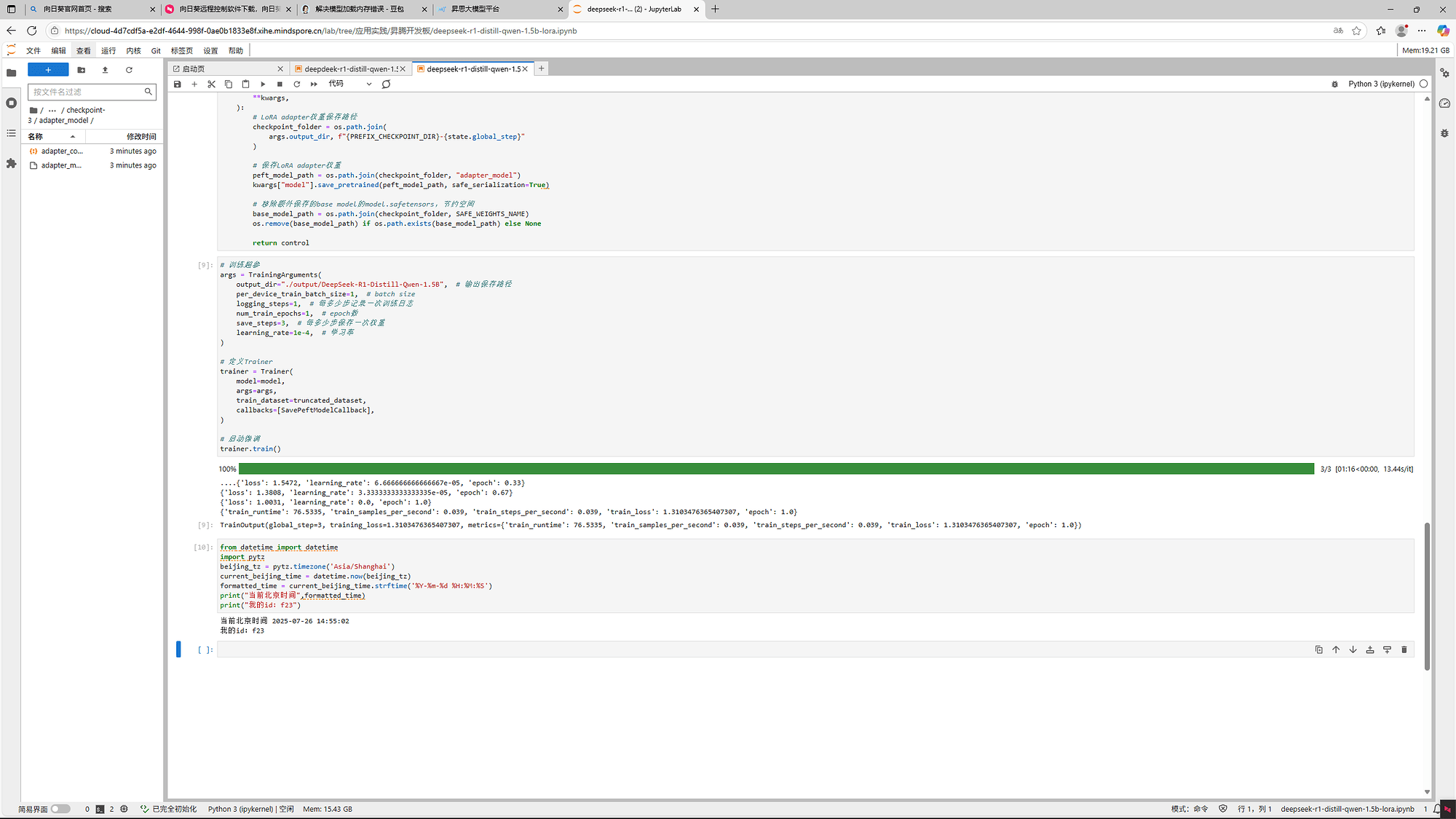

还进行了微调实战,

块引用