MoE架构

DeepSeek之所以能用较小的算力和资源成本而能获得比肩GPT4-Pro的模型性能和效果,在很大的程度上就是采取了MoE模型架构,我们在使用DeepSeek的时候经常会看到模型输入框弹出提示,说正在思考,这就是典型的MoE架构的特征,因此学习和掌握MoE架构会为我们之后的大模型学业和生涯提供很大的帮助。

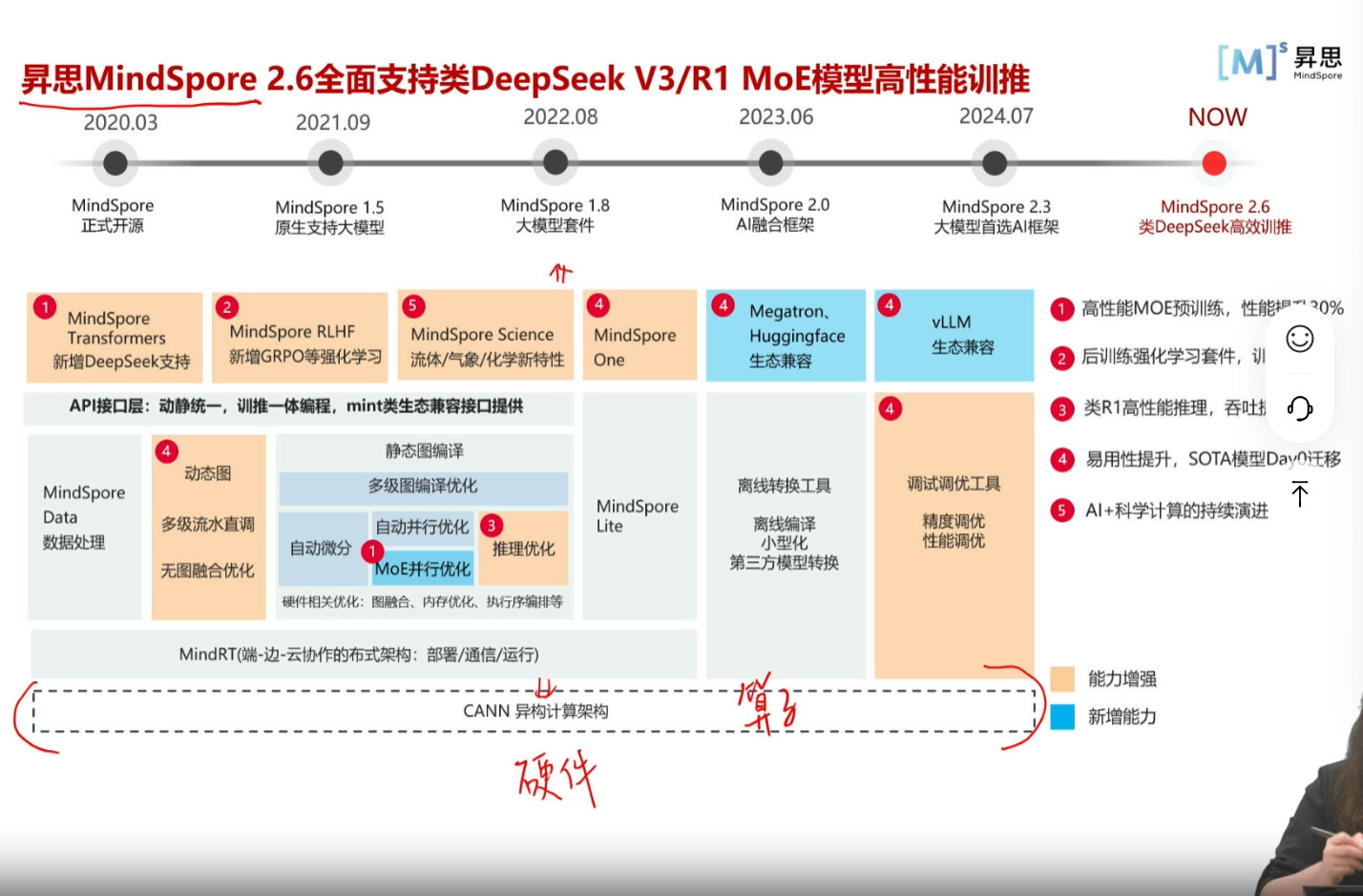

昇思MindSpore环境起到承上启下的作用,上引大模型套件,下可沟通硬件

对Transformers等架构模型具有良好的Libaray库,也对MindSporeOne多模态具有良好的支持,对市面上的常见模型提供良好对接,方便开发者训练以及迁移

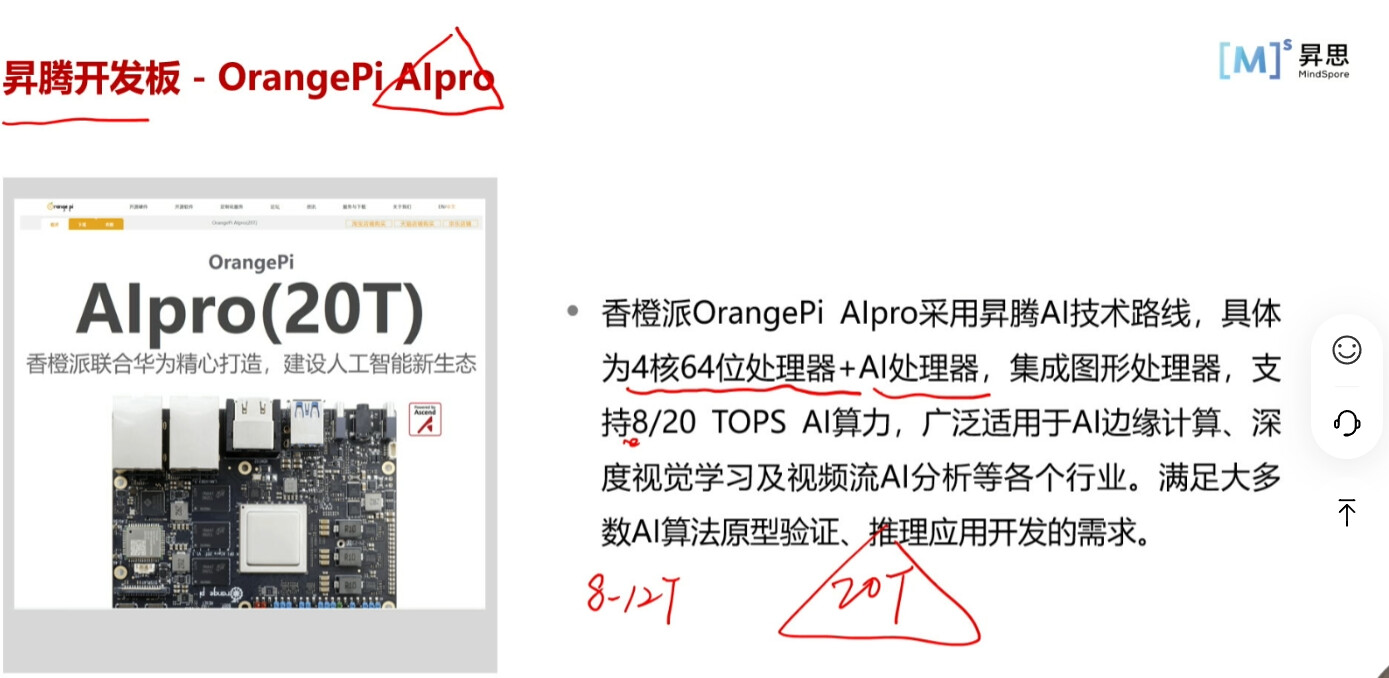

昇腾开发板-OrangePi香橙派

据介绍来说可以及其便利的跑一些轻量化模型,性能也比较优秀

基础环境为CANN 8.0.0+MindSpore2.4.10

昇腾开发板专区为案例+视频+论坛,后续设计此方面的内容可能需要用到

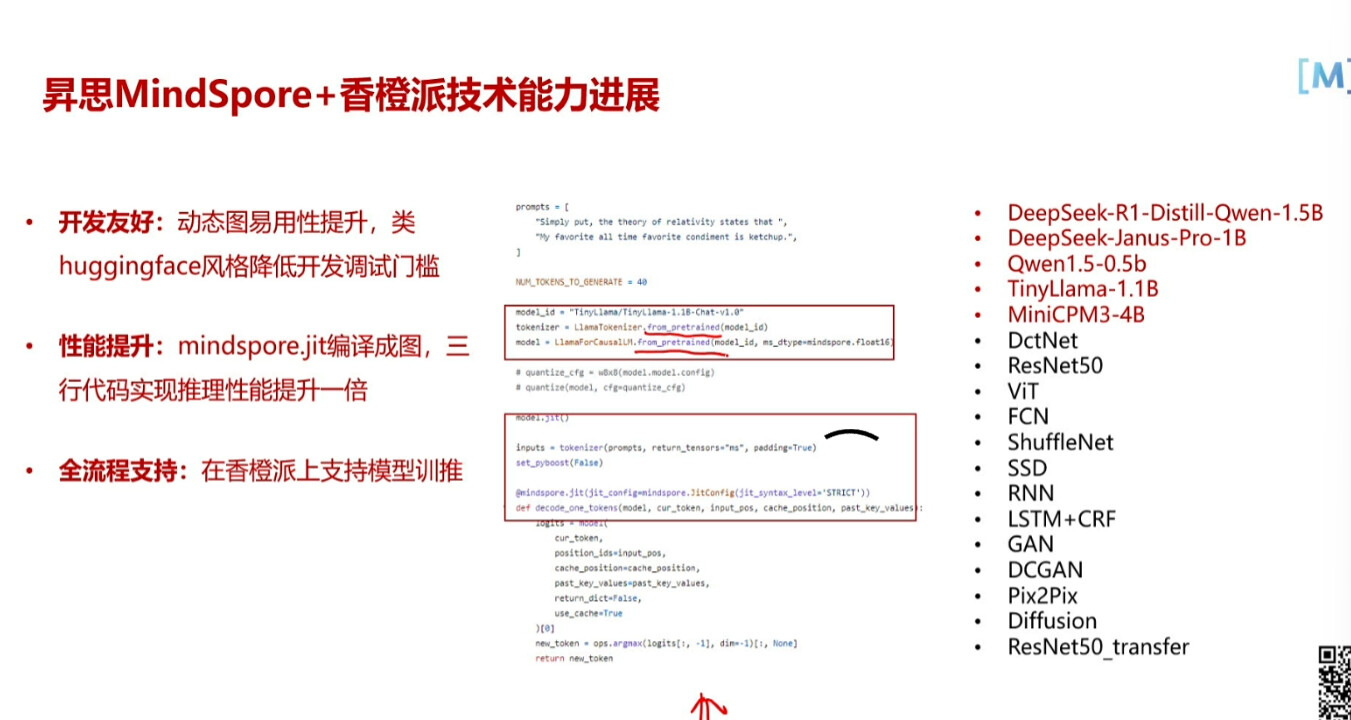

昇思MindSpore+香橙派技术能力进展

在板子上就可以进行完整的模型训练和推理

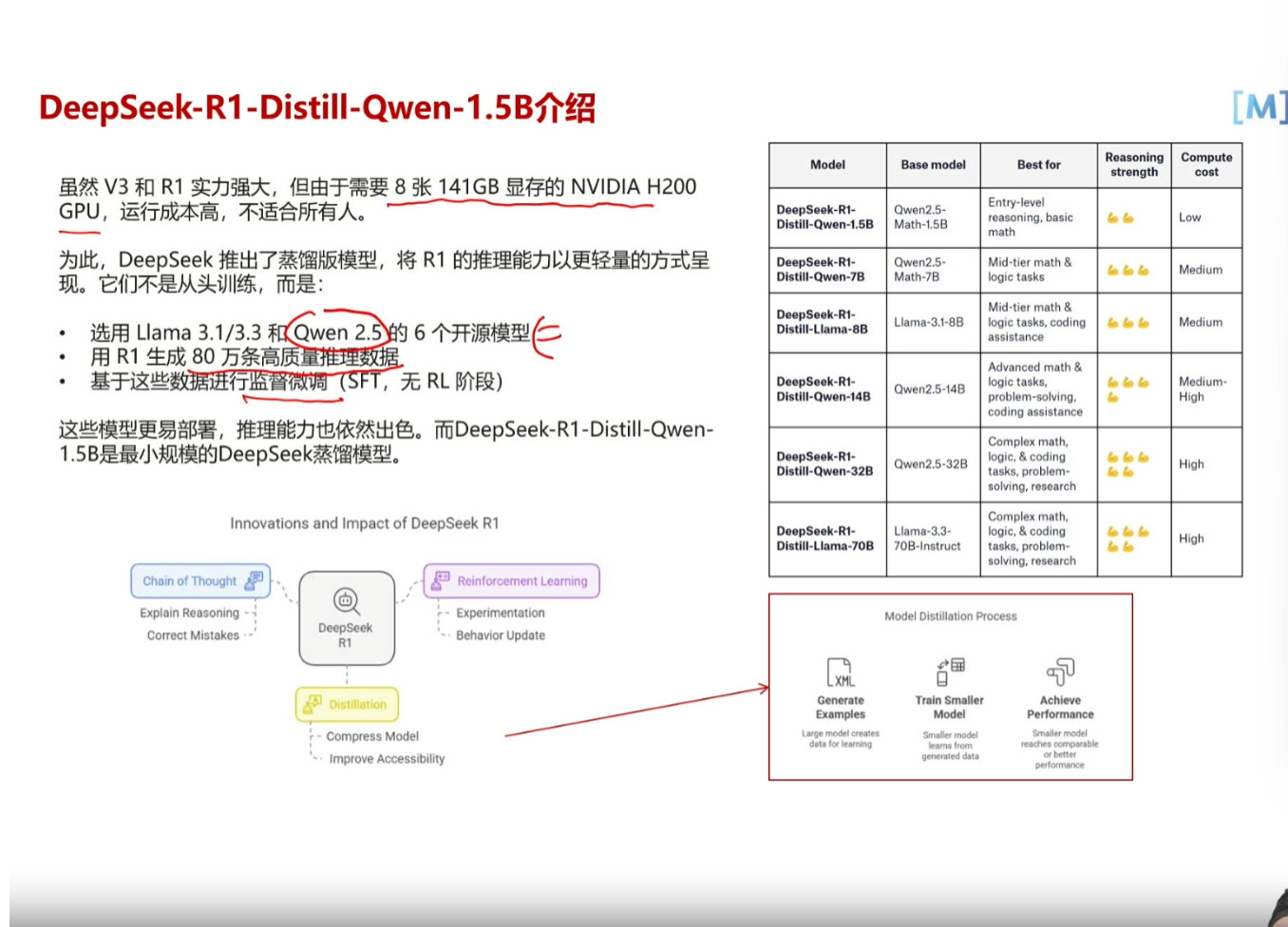

DeepSeek-R1-Distill-Qwen-1.5B模型开发与适配

在此之前本人便有一些微调模型的基础,但是从未系统学过,借此机会补充一下基础知识

DeepSeek-R1-Distill-Qwen-1.5B在香橙派上的开发与适配

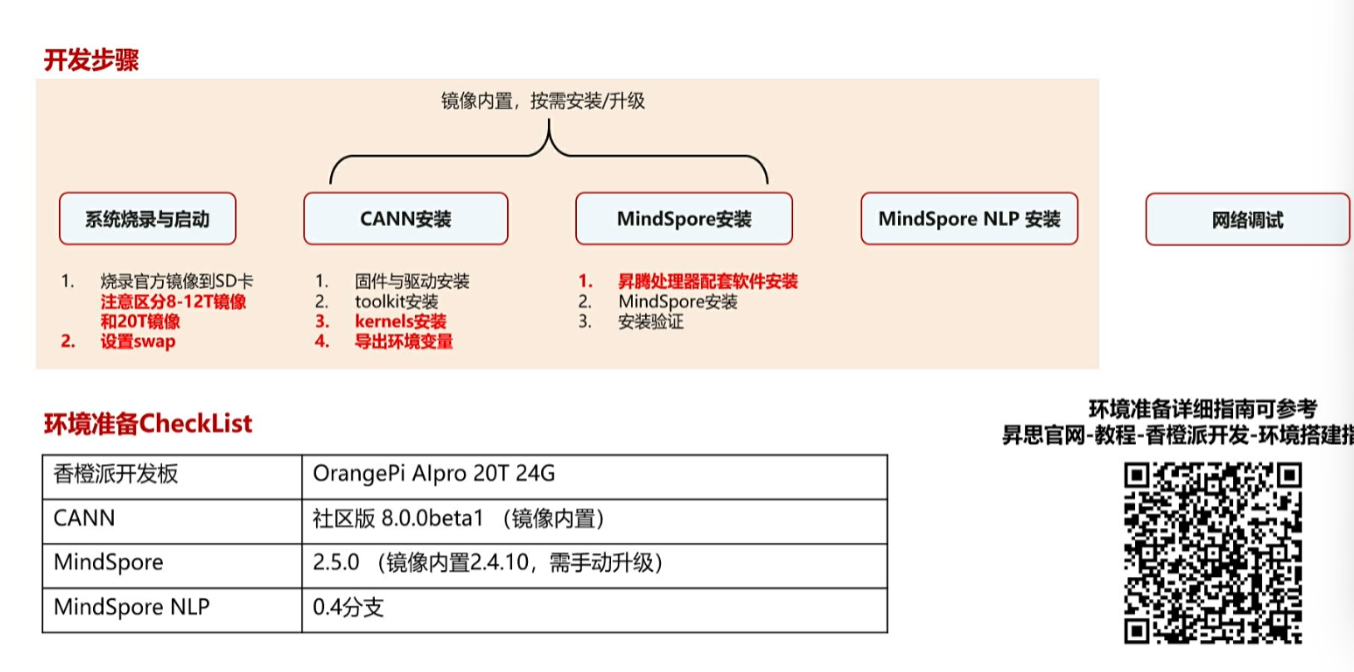

8-12T镜像与20T镜像存在区别,对应的板子要烧对应的镜像

在开发过程中可能需要用到CANN的算子,注意要与MindSpore环境匹配

在MindSpore安装时一定要注意版本匹配和依赖是否完整,手动检查一下,这个之前在使用MindSpore的框架时确实深有体会,可能依赖安装不完整导致后续报错一直检查不出来,最后半天才发现是依赖的问题

//开发板镜像版本检查

cat /usr/local/Ascend/

cat /usr/local/Ascend/ascend-toolkit

cat /usr/local/Ascend/ascend-toolkit/latest

cat /usr/local/Ascend/ascend-toolkit/latestaarch64-linux/

cat /usr/local/Ascend/ascend-toolkit/latestaarch64-linux/ascend toolkit install.info

//之后便会出现环境版本

//检查mindspore版本

pip show mindspore

//mindspore安装命令

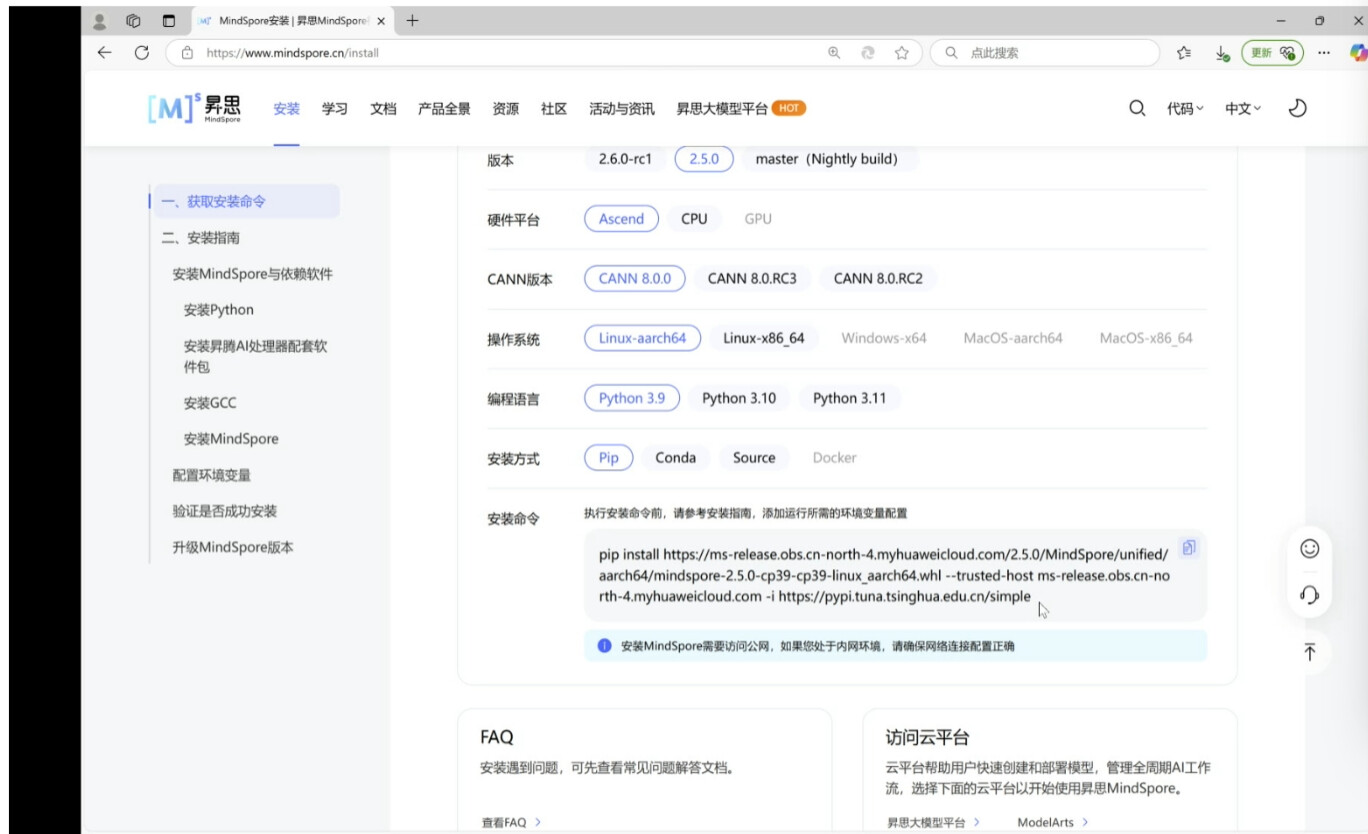

可以在官网直接复制

//检查mindnlp环境

pip show mindnlp

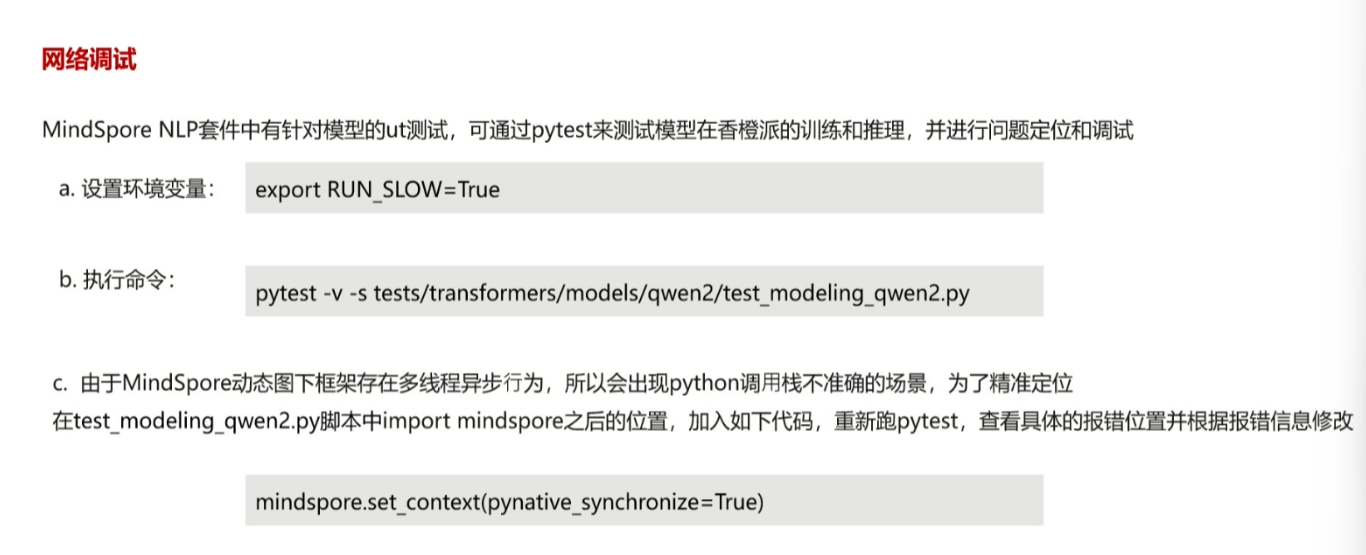

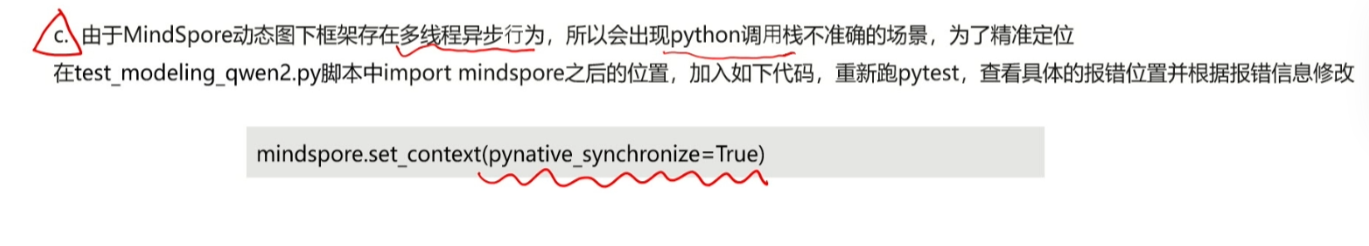

网络调试

如何快速判断模型是否能跑得起来

MindSpore nlp套件中有针对模型的ut测试

确实比其他的一些套件要方便很多之前在openmind工具链中没见过此功能

示例

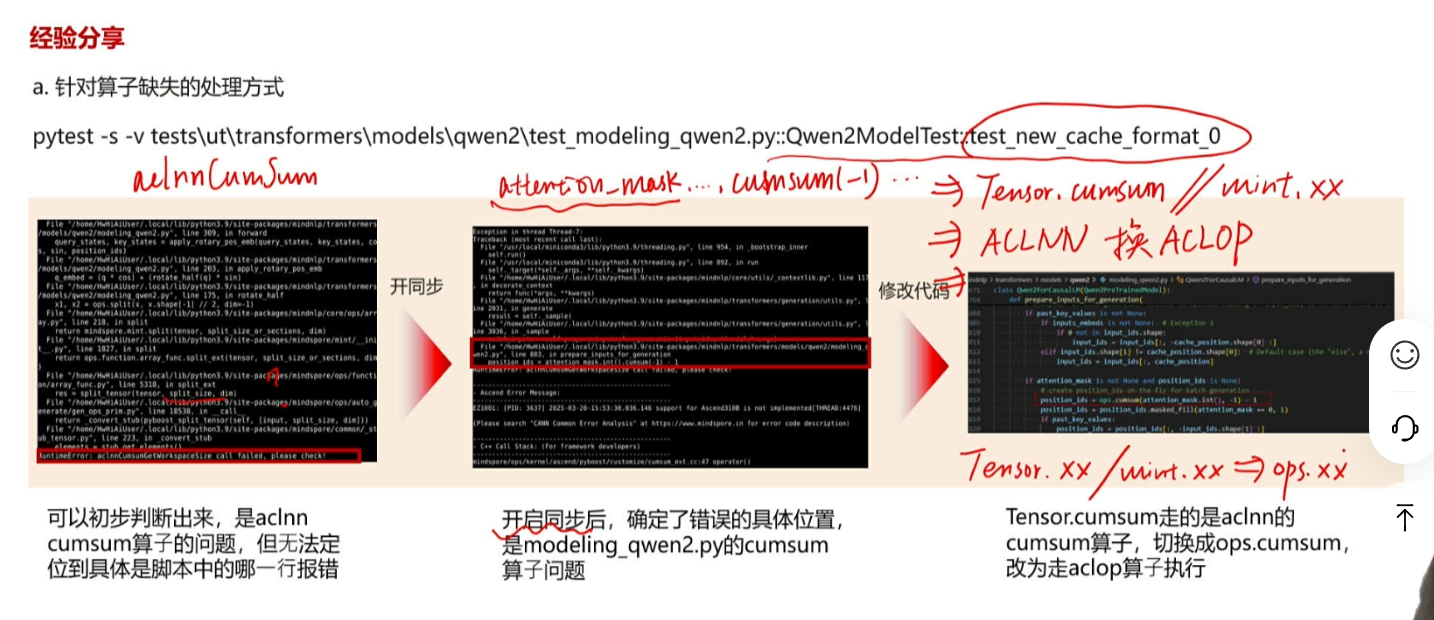

算子缺失

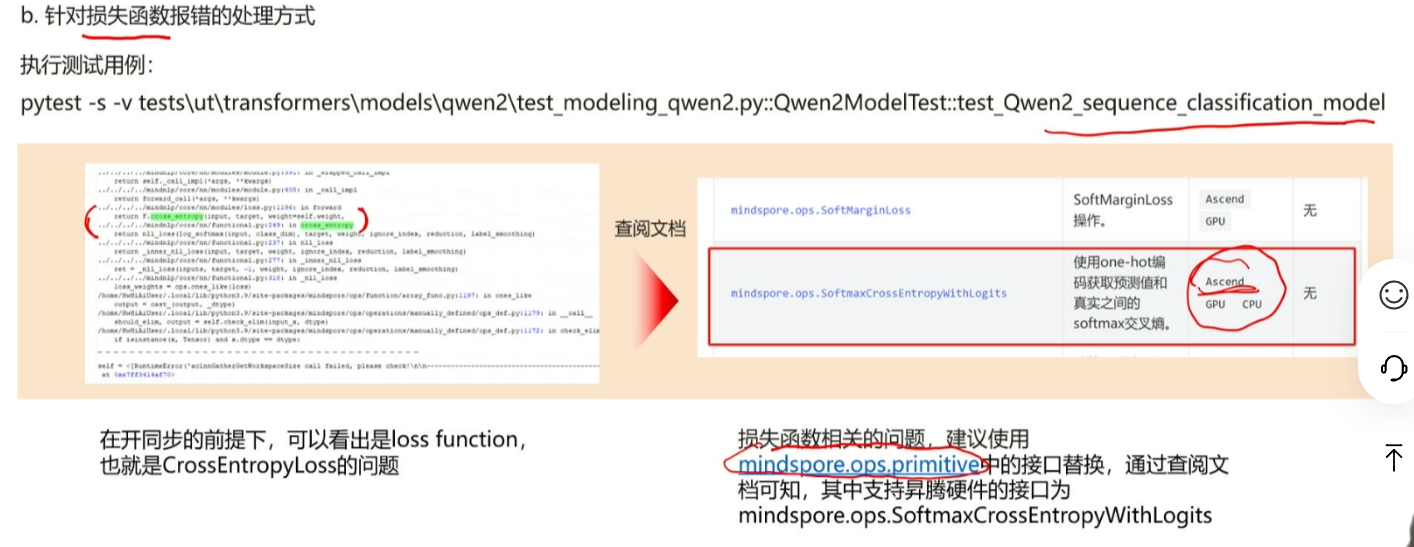

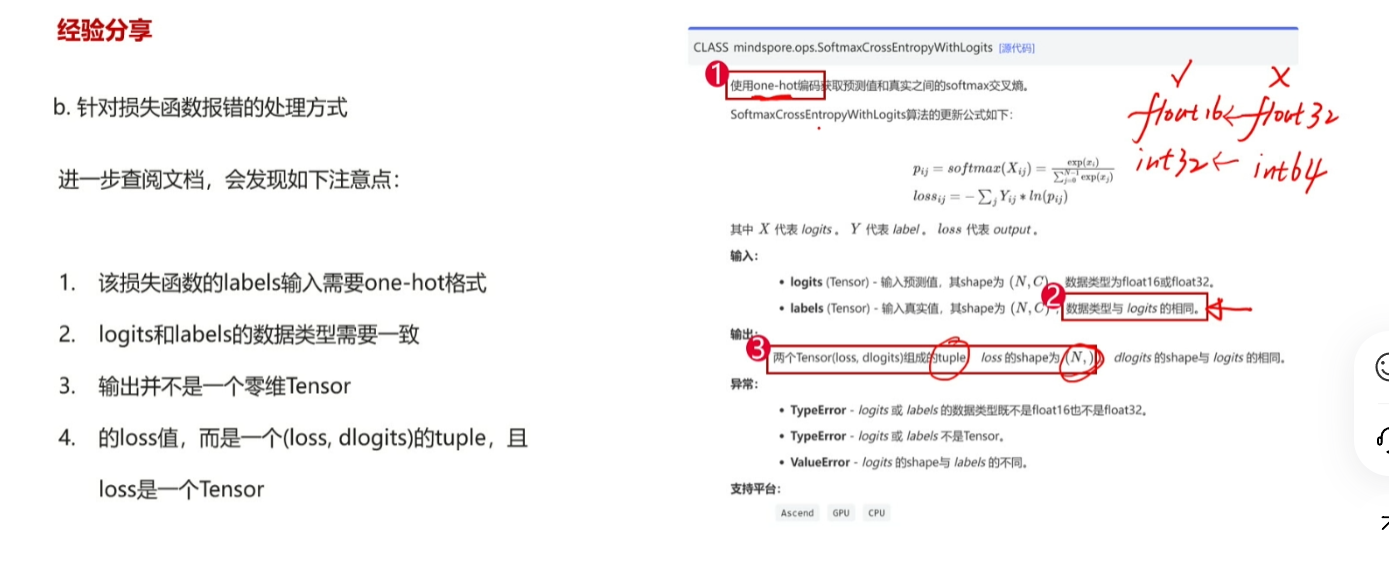

损失函数

常见于反向loss

数据类型确实是常见的报错,之前遇到过很多次,现在也算可以独自处理了

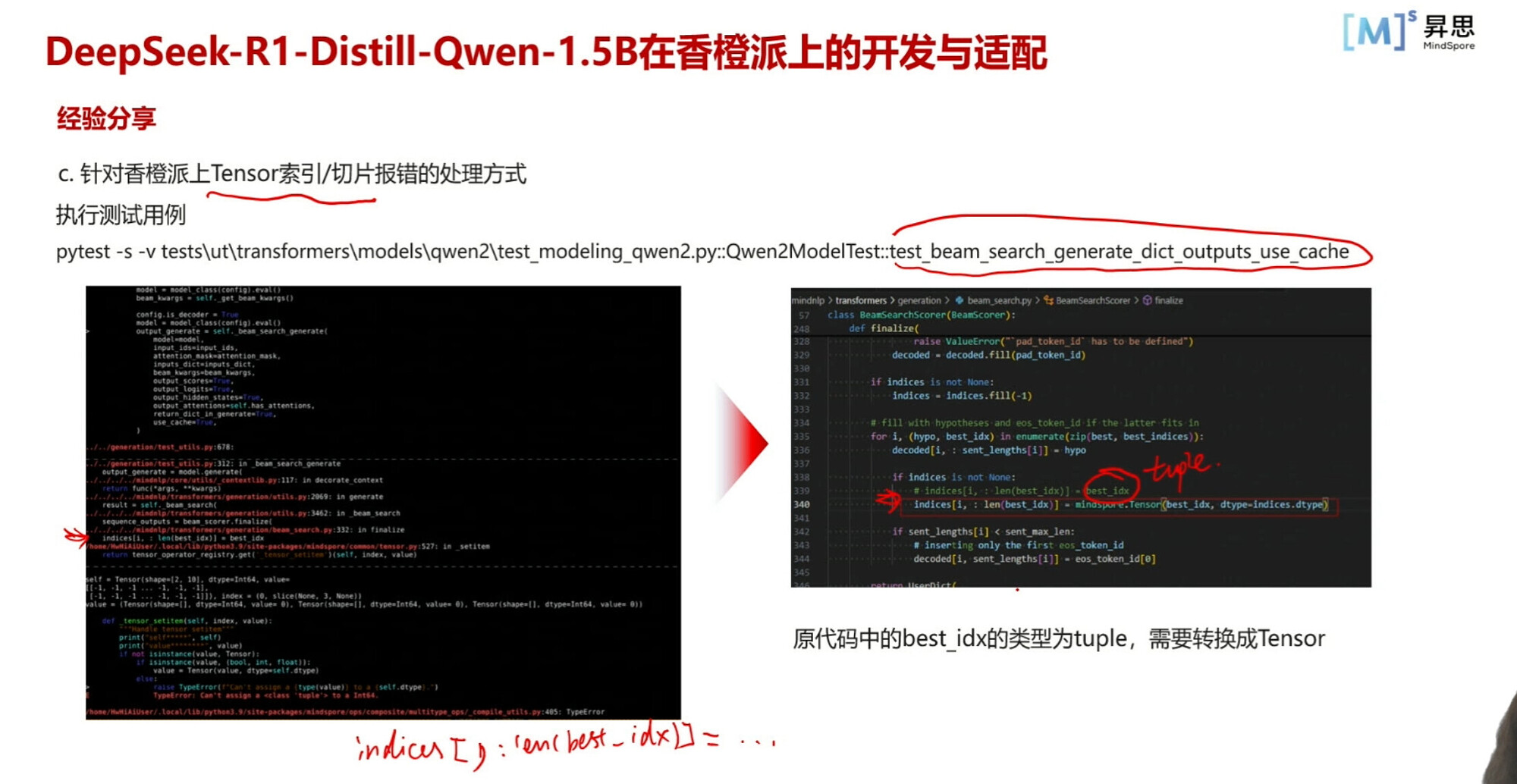

香橙派上Tensor索引/切片报错的处理方式

此问题之前在做迁移的时候也遇到过

哈哈真是一些常见的问题,之前也是靠着AI解决问题,在观看了视频之后对这些问题有了具体的理解,收获颇丰