GAN基本介绍

GAN(生成对抗网络)是一种深度学习框架,通过两个神经网络的博弈过程实现图像生成任务。其核心设计由生成器和判别器组成,二者以对抗训练的方式相互优化,最终使生成器能够输出高度逼真的图像。这种模型的创新性在于将生成问题转化为动态博弈问题,而非传统的单一损失函数优化。

生成器的任务是接收随机噪声或潜在向量作为输入,通过多层非线性变换将其映射到图像空间。初始阶段的生成图像通常质量较低,但随着训练推进,生成器逐渐学习到真实图像的数据分布特征。其网络结构常采用转置卷积或上采样操作实现空间维度的扩展,同时结合批归一化和激活函数增强非线性表达能力。值得注意的是,生成器的训练目标并非直接模仿真实图像,而是通过欺骗判别器来间接提升生成质量。

判别器则扮演质量评估者的角色,其输入为真实图像或生成图像,输出一个概率值表示输入属于真实数据的置信度。判别器的训练目标是最大化对真实图像和生成图像的分类准确率,这促使它不断挖掘真实图像中的细微特征。随着训练进行,判别器逐渐形成对图像真实性的严格评判标准,从而倒逼生成器提升生成质量。这种对抗机制形成了动态平衡:生成器努力制造更逼真的图像,判别器则持续提升鉴别能力。

训练过程采用交替优化策略。在每次迭代中,首先固定生成器参数,通过判别器的损失函数更新其权重,使其更擅长区分真假图像;随后固定判别器参数,利用生成器的损失函数(通常包含判别器对生成图像的评分)更新生成器权重。这种交替训练方式需要精心调整学习率和训练步数,否则容易出现模式崩溃或训练不稳定问题。研究者常采用Wasserstein距离等改进损失函数,或引入谱归一化等技术来增强训练稳定性。

GAN的变体模型针对不同需求进行了优化。DCGAN首次将卷积神经网络引入GAN架构,通过卷积操作提升图像生成质量;CycleGAN实现了无配对数据的图像风格迁移,通过循环一致性损失保证转换过程的合理性;StyleGAN通过分离潜在空间中的风格和内容信息,实现了对生成图像细节的精细控制,其生成的面部图像在分辨率和真实感上达到新高度。

本帖将基于Mindspore框架基于GAN实现简单的图像生成功能。

数据集准备与加载

MNIST数据集是机器学习领域经典的手写数字识别基准数据集,包含6万张训练集和1万张测试集的28×28像素灰度图像,涵盖0-9共10个数字类别。其图像均经过标准化处理,背景单一、数字居中,具有低维度、易获取的特点,常被用于测试图像分类算法性能或作为入门级深度学习项目的训练数据。尽管数据规模较小且场景简单,但因其广泛适用性和计算效率优势,至今仍是模型验证与教学演示的重要工具。

# 数据下载

from download import download

url = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/notebook/datasets/MNIST_Data.zip"

download(url, ".", kind="zip", replace=True)

# 数据加载

import numpy as np

import mindspore.dataset as ds

batch_size = 128

latent_size = 100 # 隐码的长度

train_dataset = ds.MnistDataset(dataset_dir='./MNIST_Data/train')

test_dataset = ds.MnistDataset(dataset_dir='./MNIST_Data/test')

def data_load(dataset):

dataset1 = ds.GeneratorDataset(dataset, ["image", "label"], shuffle=True, python_multiprocessing=False)

# 数据增强

mnist_ds = dataset1.map(

operations=lambda x: (x.astype("float32"), np.random.normal(size=latent_size).astype("float32")),

output_columns=["image", "latent_code"])

mnist_ds = mnist_ds.project(["image", "latent_code"])

# 批量操作

mnist_ds = mnist_ds.batch(batch_size, True)

return mnist_ds

mnist_ds = data_load(train_dataset)

iter_size = mnist_ds.get_dataset_size()

print('Iter size: %d' % iter_size)

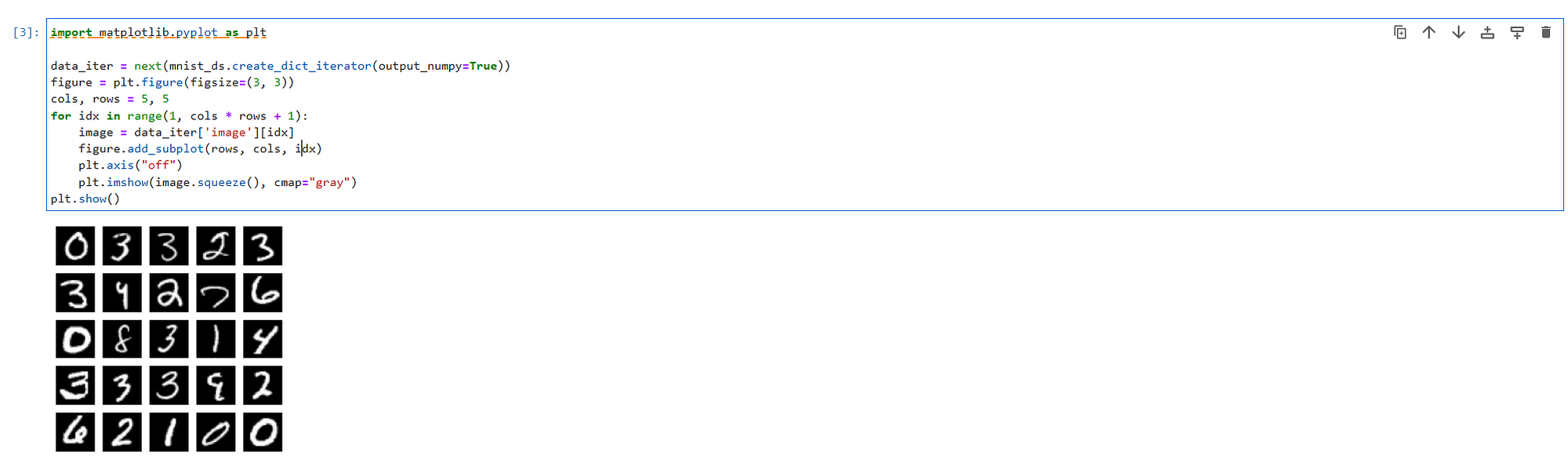

对数据集可以进行初步可视化展示

import matplotlib.pyplot as plt

data_iter = next(mnist_ds.create_dict_iterator(output_numpy=True))

figure = plt.figure(figsize=(3, 3))

cols, rows = 5, 5

for idx in range(1, cols * rows + 1):

image = data_iter['image'][idx]

figure.add_subplot(rows, cols, idx)

plt.axis("off")

plt.imshow(image.squeeze(), cmap="gray")

plt.show()

可通过注入遵循高斯分布的隐码到生成器中来评估生成器的质量,代码如下:

import random

import numpy as np

from mindspore import Tensor, dtype

# 利用随机种子创建一批隐码

np.random.seed(2323)

test_noise = Tensor(np.random.normal(size=(25, 100)), dtype.float32)

random.shuffle(test_noise)

模型构建

GAN结构主体包括一个生成器和一个判别器,生成器代码如下:

from mindspore import nn

import mindspore.ops as ops

img_size = 28 # 训练图像长(宽)

class Generator(nn.Cell):

def __init__(self, latent_size, auto_prefix=True):

super(Generator, self).__init__(auto_prefix=auto_prefix)

self.model = nn.SequentialCell()

# [N, 100] -> [N, 128]

# 输入一个100维的0~1之间的高斯分布,然后通过第一层线性变换将其映射到256维

self.model.append(nn.Dense(latent_size, 128))

self.model.append(nn.ReLU())

# [N, 128] -> [N, 256]

self.model.append(nn.Dense(128, 256))

self.model.append(nn.BatchNorm1d(256))

self.model.append(nn.ReLU())

# [N, 256] -> [N, 512]

self.model.append(nn.Dense(256, 512))

self.model.append(nn.BatchNorm1d(512))

self.model.append(nn.ReLU())

# [N, 512] -> [N, 1024]

self.model.append(nn.Dense(512, 1024))

self.model.append(nn.BatchNorm1d(1024))

self.model.append(nn.ReLU())

# [N, 1024] -> [N, 784]

# 经过线性变换将其变成784维

self.model.append(nn.Dense(1024, img_size * img_size))

# 经过Tanh激活函数是希望生成的假的图片数据分布能够在-1~1之间

self.model.append(nn.Tanh())

def construct(self, x):

img = self.model(x)

return ops.reshape(img, (-1, 1, 28, 28))

net_g = Generator(latent_size)

net_g.update_parameters_name('generator')

判别器实现代码如下:

# 判别器

class Discriminator(nn.Cell):

def __init__(self, auto_prefix=True):

super().__init__(auto_prefix=auto_prefix)

self.model = nn.SequentialCell()

# [N, 784] -> [N, 512]

self.model.append(nn.Dense(img_size * img_size, 512)) # 输入特征数为784,输出为512

self.model.append(nn.LeakyReLU()) # 默认斜率为0.2的非线性映射激活函数

# [N, 512] -> [N, 256]

self.model.append(nn.Dense(512, 256)) # 进行一个线性映射

self.model.append(nn.LeakyReLU())

# [N, 256] -> [N, 1]

self.model.append(nn.Dense(256, 1))

self.model.append(nn.Sigmoid()) # 二分类激活函数,将实数映射到[0,1]

def construct(self, x):

x_flat = ops.reshape(x, (-1, img_size * img_size))

return self.model(x_flat)

net_d = Discriminator()

net_d.update_parameters_name('discriminator')

然后构建损失函数和优化器:

lr = 0.0002 # 学习率

# 损失函数

adversarial_loss = nn.BCELoss(reduction='mean')

# 优化器

optimizer_d = nn.Adam(net_d.trainable_params(), learning_rate=lr, beta1=0.5, beta2=0.999)

optimizer_g = nn.Adam(net_g.trainable_params(), learning_rate=lr, beta1=0.5, beta2=0.999)

optimizer_g.update_parameters_name('optim_g')

optimizer_d.update_parameters_name('optim_d')

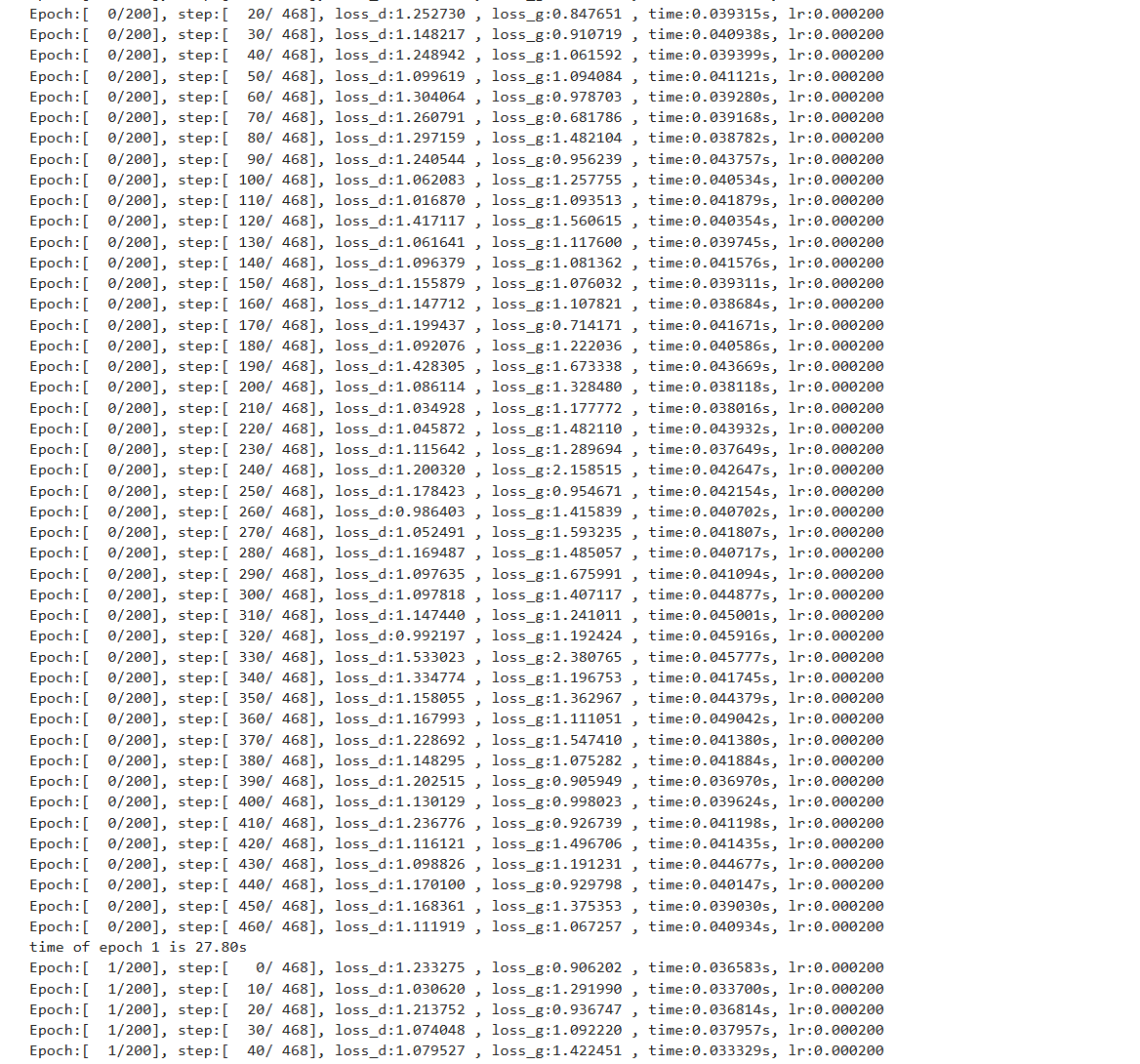

模型训练

定义完基本参数后,进行模型的训练,训练包括两部分,训练判别器后再训练生成器。

训练代码如下:

import os

import time

import matplotlib.pyplot as plt

import mindspore as ms

from mindspore import Tensor, save_checkpoint

total_epoch = 200 # 训练周期数

batch_size = 128 # 用于训练的训练集批量大小

# 加载预训练模型的参数

pred_trained = False

pred_trained_g = './result/checkpoints/Generator99.ckpt'

pred_trained_d = './result/checkpoints/Discriminator99.ckpt'

checkpoints_path = "./result/checkpoints" # 结果保存路径

image_path = "./result/images" # 测试结果保存路径

# 生成器计算损失过程

def generator_forward(test_noises):

fake_data = net_g(test_noises)

fake_out = net_d(fake_data)

loss_g = adversarial_loss(fake_out, ops.ones_like(fake_out))

return loss_g

# 判别器计算损失过程

def discriminator_forward(real_data, test_noises):

fake_data = net_g(test_noises)

fake_out = net_d(fake_data)

real_out = net_d(real_data)

real_loss = adversarial_loss(real_out, ops.ones_like(real_out))

fake_loss = adversarial_loss(fake_out, ops.zeros_like(fake_out))

loss_d = real_loss + fake_loss

return loss_d

# 梯度方法

grad_g = ms.value_and_grad(generator_forward, None, net_g.trainable_params())

grad_d = ms.value_and_grad(discriminator_forward, None, net_d.trainable_params())

def train_step(real_data, latent_code):

# 计算判别器损失和梯度

loss_d, grads_d = grad_d(real_data, latent_code)

optimizer_d(grads_d)

loss_g, grads_g = grad_g(latent_code)

optimizer_g(grads_g)

return loss_d, loss_g

# 保存生成的test图像

def save_imgs(gen_imgs1, idx):

for i3 in range(gen_imgs1.shape[0]):

plt.subplot(5, 5, i3 + 1)

plt.imshow(gen_imgs1[i3, 0, :, :] / 2 + 0.5, cmap="gray")

plt.axis("off")

plt.savefig(image_path + "/test_{}.png".format(idx))

# 设置参数保存路径

os.makedirs(checkpoints_path, exist_ok=True)

# 设置中间过程生成图片保存路径

os.makedirs(image_path, exist_ok=True)

net_g.set_train()

net_d.set_train()

# 储存生成器和判别器loss

losses_g, losses_d = [], []

for epoch in range(total_epoch):

start = time.time()

for (iter, data) in enumerate(mnist_ds):

start1 = time.time()

image, latent_code = data

image = (image - 127.5) / 127.5 # [0, 255] -> [-1, 1]

image = image.reshape(image.shape[0], 1, image.shape[1], image.shape[2])

d_loss, g_loss = train_step(image, latent_code)

end1 = time.time()

if iter % 10 == 0:

print(f"Epoch:[{int(epoch):>3d}/{int(total_epoch):>3d}], "

f"step:[{int(iter):>4d}/{int(iter_size):>4d}], "

f"loss_d:{d_loss.asnumpy():>4f} , "

f"loss_g:{g_loss.asnumpy():>4f} , "

f"time:{(end1 - start1):>3f}s, "

f"lr:{lr:>6f}")

end = time.time()

print("time of epoch {} is {:.2f}s".format(epoch + 1, end - start))

losses_d.append(d_loss.asnumpy())

losses_g.append(g_loss.asnumpy())

# 每个epoch结束后,使用生成器生成一组图片

gen_imgs = net_g(test_noise)

save_imgs(gen_imgs.asnumpy(), epoch)

# 根据epoch保存模型权重文件

if epoch % 1 == 0:

save_checkpoint(net_g, checkpoints_path + "/Generator%d.ckpt" % (epoch))

save_checkpoint(net_d, checkpoints_path + "/Discriminator%d.ckpt" % (epoch))

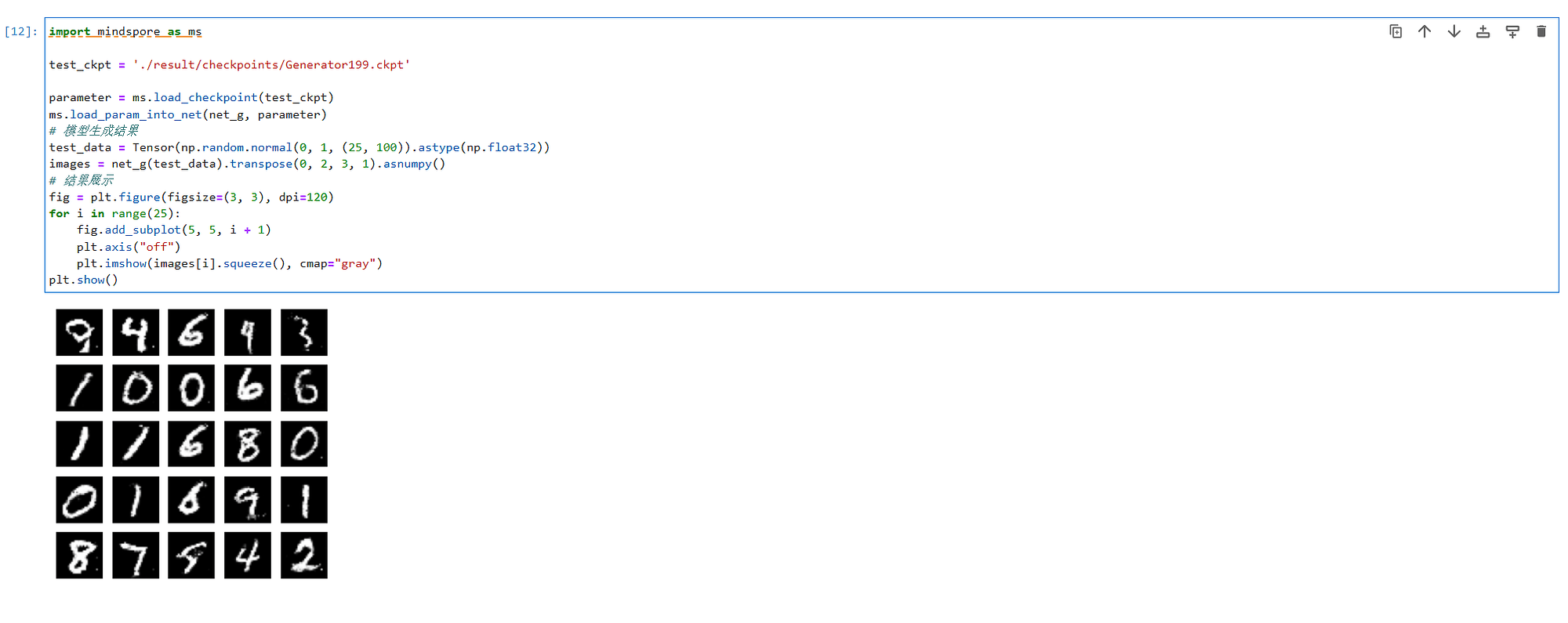

模型推理与效果展示

然后就可以加载训练好的模型尝试进行图像生成

import mindspore as ms

test_ckpt = './result/checkpoints/Generator199.ckpt'

parameter = ms.load_checkpoint(test_ckpt)

ms.load_param_into_net(net_g, parameter)

# 模型生成结果

test_data = Tensor(np.random.normal(0, 1, (25, 100)).astype(np.float32))

images = net_g(test_data).transpose(0, 2, 3, 1).asnumpy()

# 结果展示

fig = plt.figure(figsize=(3, 3), dpi=120)

for i in range(25):

fig.add_subplot(5, 5, i + 1)

plt.axis("off")

plt.imshow(images[i].squeeze(), cmap="gray")

plt.show()