通过本次基于昇思MindSpore NLP平台和昇腾AI开发板进行的LoRA微调实践,我深入了解并动手完成了参数高效微调技术(LoRA, Low-Rank Adaptation)在大语言模型上的应用流程。此次项目以《甄嬛传》对话风格模仿为任务目标,使用了DeepSeek-R1-Distill-Qwen-1.5B模型,并结合LoRA方法对其进行微调。

理解LoRA原理

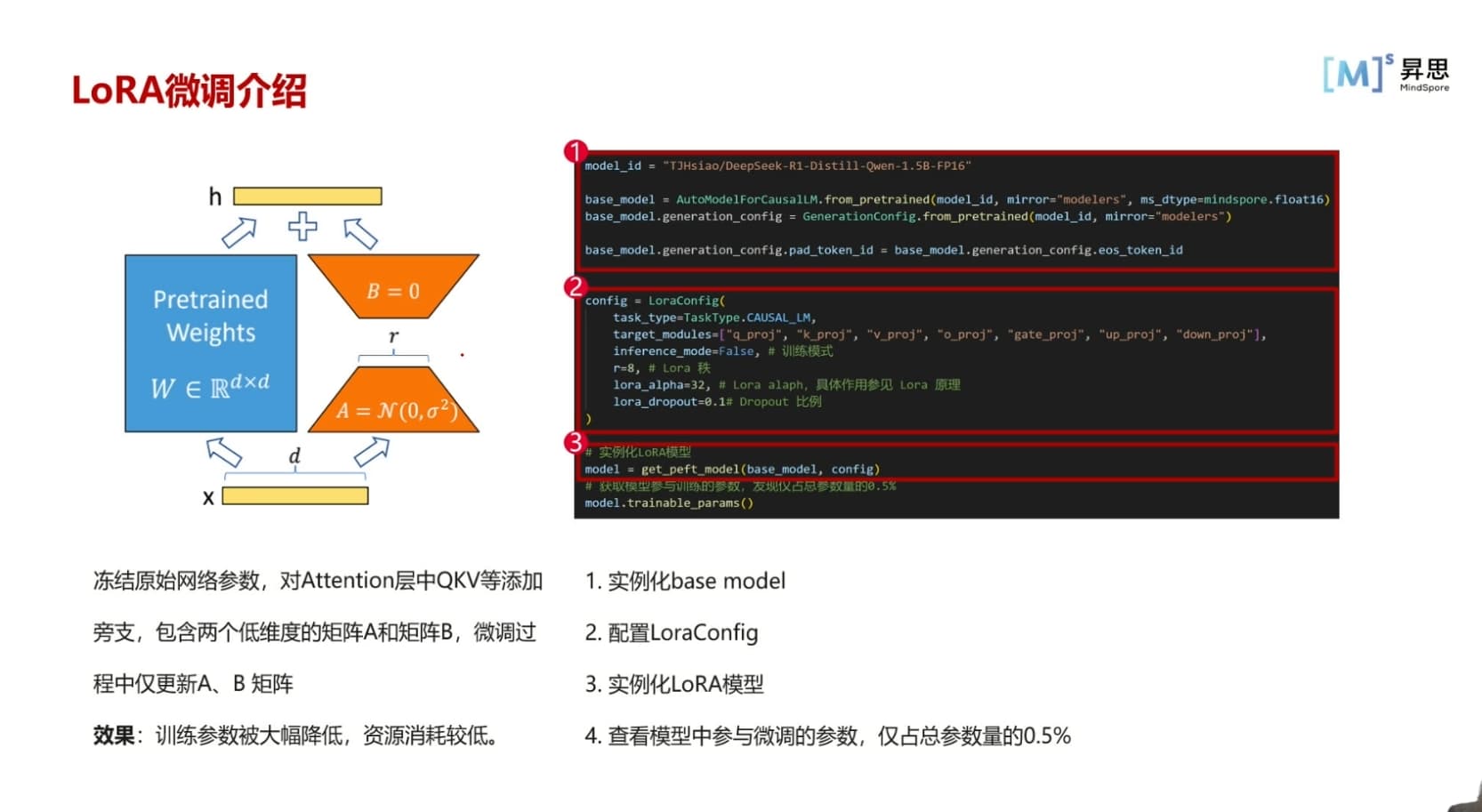

LoRA的核心思想是冻结预训练模型的全部权重,仅在关键模块(如Q、K、V和FFN层)中加入可训练的低秩矩阵A和B。这种方法大大减少了训练所需的参数量和计算资源,使得在资源受限的开发板环境中也能高效地完成大模型的定制任务。本次实践中,通过调节r和lora_alpha参数,我观察到了LoRA微调部分仅占总参数量约0.516%,而效果却接近全参数微调,印证了其高效性。

实践操作流程

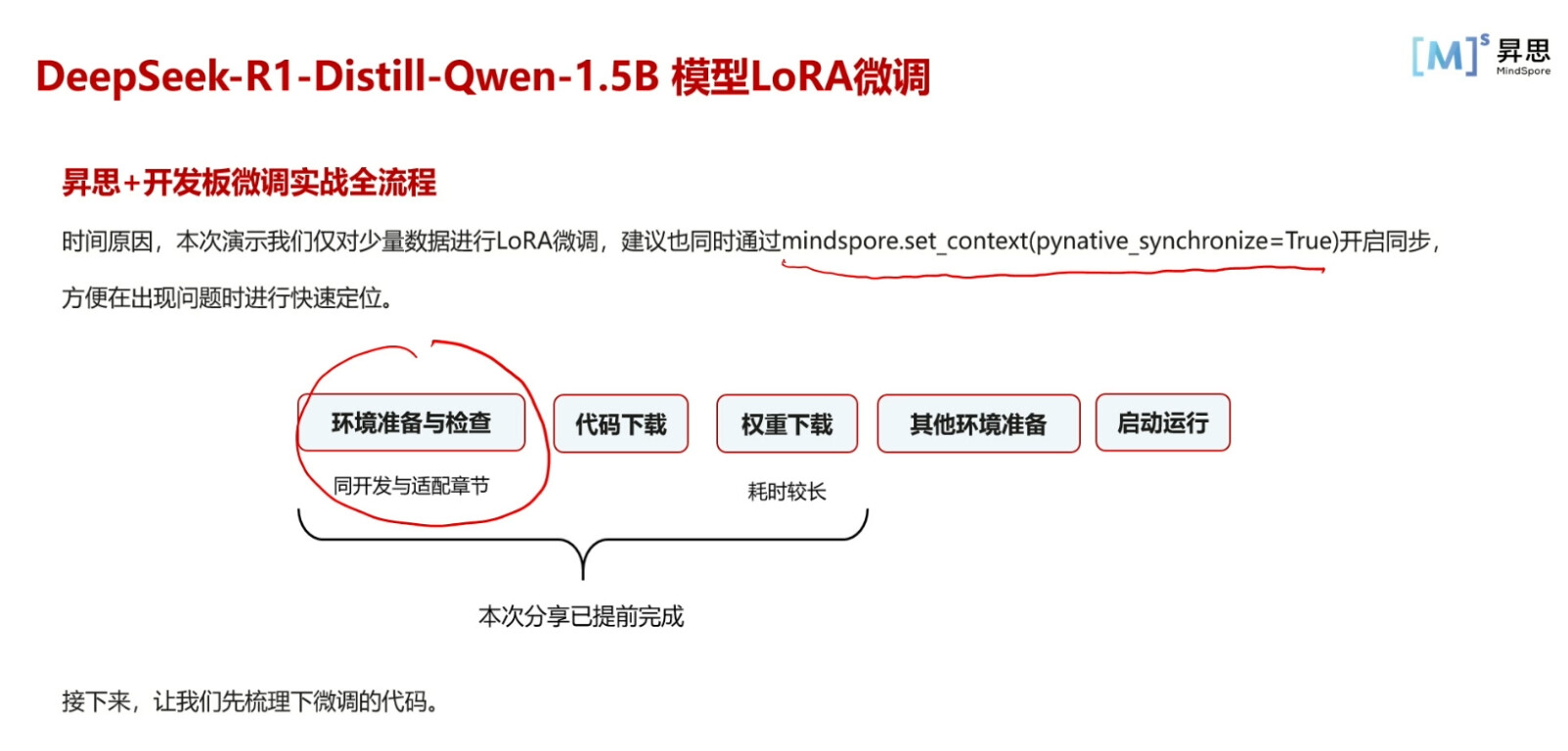

从环境配置到模型微调再到推理部署,整个流程让我全面掌握了使用MindSpore NLP工具链进行LoRA微调的实操步骤:

利用 AutoModelForCausalLM 和 AutoTokenizer 加载模型;

通过 LoraConfig 配置目标模块、秩和缩放因子;

用 get_peft_model 构造微调模型;

采用自定义回调函数保存Adapter权重;

最后使用 Gradio 构建可交互推理界面。

其中的数据预处理环节也非常关键,通过process_func函数对剧本数据进行格式化并生成适配输入,有效提升了模型理解上下文的能力。

实战价值体会

与传统大模型训练相比,LoRA微调显著降低了成本门槛,在昇腾AI开发板这样算力有限的硬件平台上也能完成任务,为边缘智能和个性化应用部署提供了现实路径。这种“软硬结合”的训练方式非常契合当下轻量化部署的发展趋势。