加入CSDN的昇思MindSpore社区 昇思MindSpore社区-CSDN社区云

1. 前言

作为一名深度学习领域的开发者,我对计算机视觉方向的前沿模型一直保持关注。Meta发布的Segment Anything Model(SAM)凭借其零样本分割能力,成为了该领域的标志性工作。

近期,华为开源自研AI框架昇思MindSpore的生态库MindNLP集成了SAM模型。为了验证国产框架对大规模Transformer模型的支持能力,并探索SAM在实际推理任务中的表现,我参考官方社区教程,基于MindSpore和MindNLP复现了这一模型。本文将详细记录复现过程中的技术细节与思考。

参考来源:MindSpore官方教程图像分割模型

2. 环境搭建

复现的第一步永远是配环境。我使用的是昇思大模型的Notebook环境(不得不说,云环境省去了很多本地配置驱动的烦恼)。

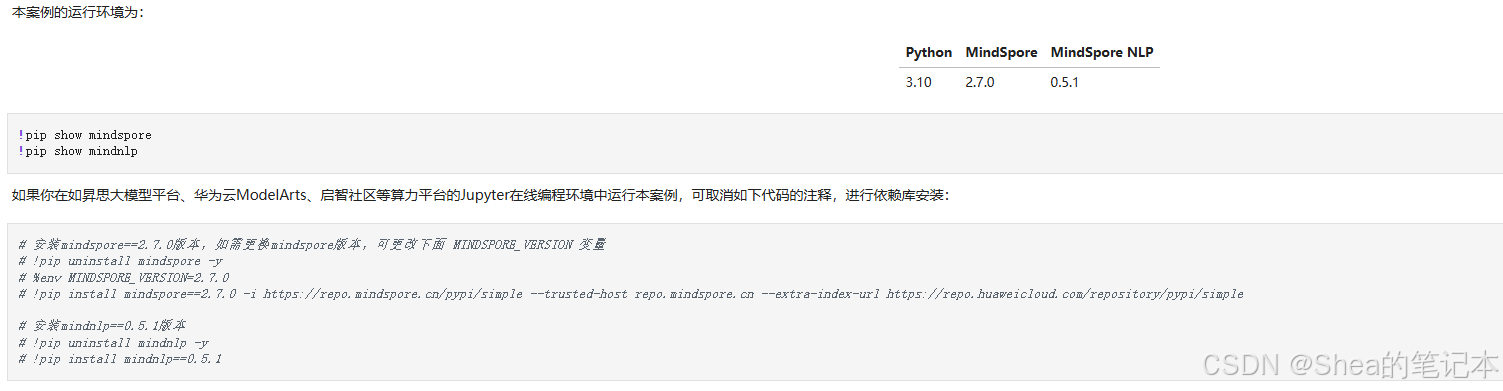

2.1 检查版本

打开Notebook,我先看了一眼预置环境:

!pip show mindspore

输出显示是旧版本。查看案例要求,明确指出需要 MindSpore 2.7.0 和 MindNLP 0.5.1。

2.2 升级安装

这里我直接照搬了教程里的安装命令,不过为了稳妥,我先卸载了旧版本:

# 卸载旧版本,避免冲突

!pip uninstall mindspore -y

!pip uninstall mindnlp -y

# 安装指定版本

%env MINDSPORE_VERSION=2.7.0

!pip install mindspore==2.7.0 -i https://repo.mindspore.cn/pypi/simple --trusted-host repo.mindspore.cn

!pip install mindnlp==0.5.1

体验点:安装过程比预想的快,镜像源速度很给力。安装完后再次check版本,确认无误。这一步顺利通过

3. 代码复现:见证分割时刻

环境搞定后,就是激动人心的跑代码环节了。

3.1 导包与数据准备

导入mindspore和mindnlp的相关模块。这一步没啥好说的,直接运行。

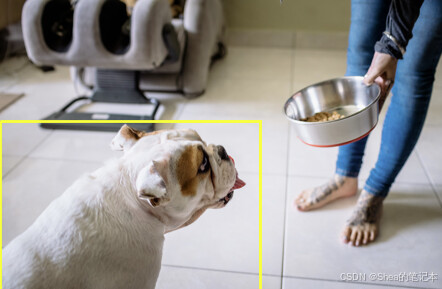

教程里用了一张经典的狗狗图片。我直接运行了下载代码:

image_url = "https://raw.githubusercontent.com/facebookresearch/segment-anything/main/notebooks/images/dog.jpg"

# ...下载代码省略...

图片下载成功。接下来是定义提示框(Bounding Box)。

bbox = [0, 217, 450, 800] # [x1, y1, x2, y2]

这里我稍微停顿了一下。SAM是需要Prompt的,这个坐标是针对这张狗狗图手动调好的。如果是自己的图,可能需要用画图工具先看下坐标。为了还原效果,我先老老实实用了教程的坐标。

画出来的图是这样的(黄色框确实框住了狗头和身体):

3.2 加载模型

MODEL_ID = "facebook/sam-vit-base"

processor = SamProcessor.from_pretrained(MODEL_ID, cache_dir=CACHE_DIR)

model = SamModel.from_pretrained(MODEL_ID, cache_dir=CACHE_DIR)

体验点:

运行这行代码时,能看到后台在自动下载权重文件。MindNLP的设计逻辑跟Hugging Face的Transformers几乎一样,接口非常亲切。

大概等了几十秒(取决于网速),模型加载成功!控制台打印出加载完成,悬着的心放下了。MindSpore在加载这种PyTorch权重的模型时,底层应该是做了自动转换,用户完全无感,这点好评。![]()

3.3 执行推理

推理代码简洁得令人发指,就两行:

inputs = processor(images=image, input_boxes=[[bbox]], return_tensors="pt")

outputs = model(**inputs)

体验点:

秒出结果!

在GPU环境下,推理延迟几乎可以忽略不计。输出的outputs里包含了pred_masks(预测掩码)和iou_scores(置信度分数)。

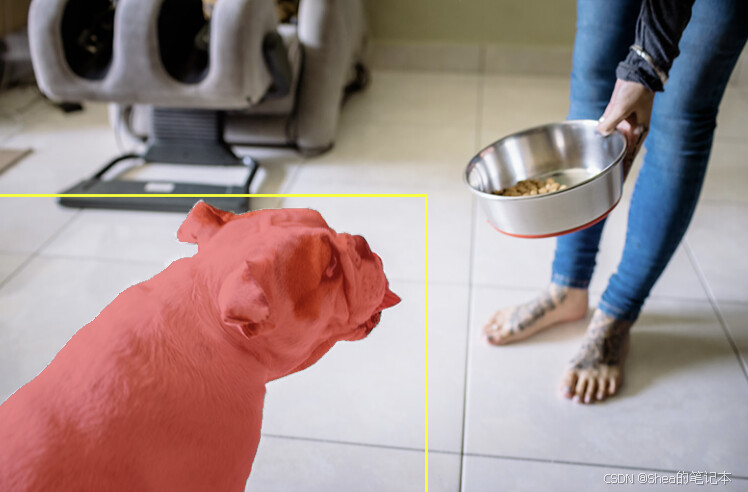

3.4 结果可视化

教程里提供了一段可视化代码,把Mask叠加到原图上。

SAM默认会输出3个不同层级的Mask(整体、部分等)。

我运行了可视化代码,看到了3个候选结果。

其中IoU分数最高的一个(Score约0.99),完美地贴合了狗狗的轮廓。

仔细看图,狗耳朵的边缘、毛发的细节,都被分割得非常干净。这就是SAM强大的Zero-Shot能力,而MindSpore完美地复现了这一能力。

4. 总结

- 代码量极少:核心逻辑不到10行,MindNLP封装得很好。

- 生态兼容性:作为一个习惯了PyTorch + HF的开发者,切换到MindSpore + MindNLP几乎没有学习成本。

- 性能:虽然只是简单的推理,但响应速度很快,感觉MindSpore在图编译和执行效率上确实有两把刷子。

结论:官方这个案例完全可复现,且体验良好。如果你也想在国产硬件或框架上体验大模型能力,MindNLP是一个非常值得尝试的选择!